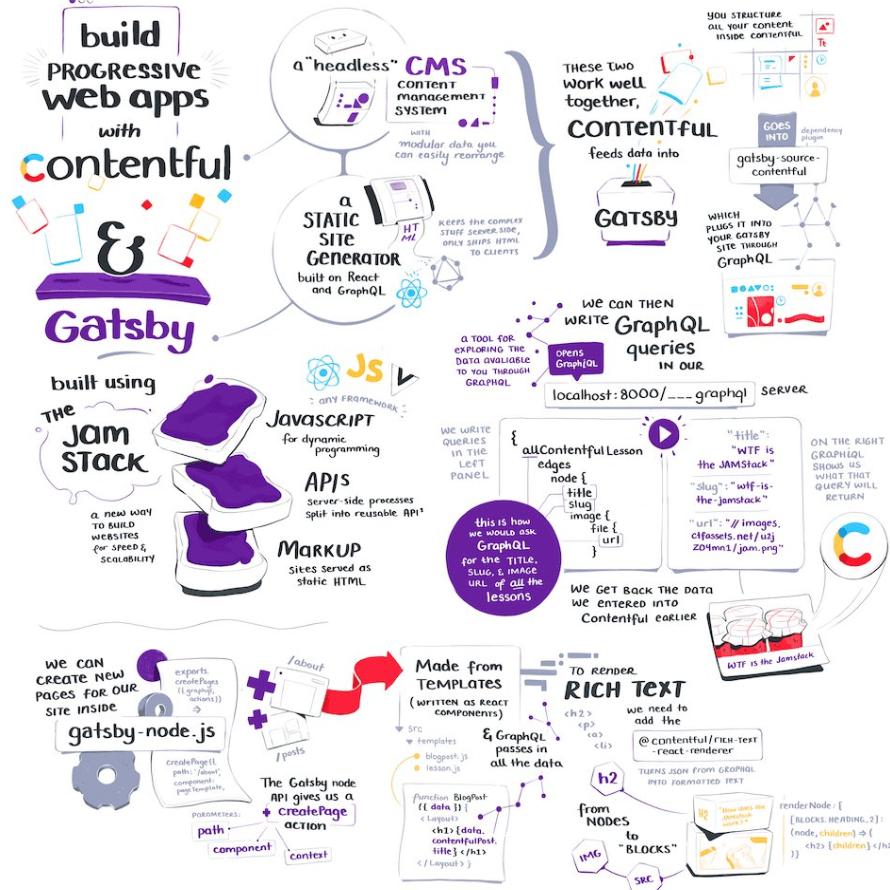

Hvad er BERT?

BERT er en foruddannet ikke-overvåget model for naturligt sprogforarbejdning. BERT kan overgå 11 af de mest almindelige NLP-opgaver efter finjustering og i det væsentlige blive en raketforstærker for Natural Language Processing and Understanding.

BERT er dybt tovejs, hvilket betyder, at den ser på ordene før og efter enheder og kontekst, der er foruddannet på Wikipedia for at give en rigere sprogforståelse.

Tjek denne Whiteboard fredag for mere kontekst omkring, hvad en uovervåget model er.